Suchmaschine

Eine Suchmaschine ist ein Programm zur Recherche von Dokumenten, die in einem Computer oder einem Computernetzwerk wie z. B. dem World Wide Web gespeichert sind. Nach Erstellung einer Suchanfrage, oftmals durch Texteingabe eines Suchbegriffs, liefert eine Suchmaschine eine Liste von Verweisen auf möglicherweise relevante Dokumente, meistens dargestellt mit Titel und einem kurzen Auszug des jeweiligen Dokuments. Dabei werden verschiedene Suchverfahren verwendet.

Die wesentlichen Bestandteile bzw. Aufgabenbereiche einer Suchmaschine sind:

- Erstellung und Pflege eines Index (Datenstruktur mit Informationen über Dokumente),

- Verarbeiten von Suchanfragen (Finden und Ordnen von Ergebnissen) sowie

- Aufbereitung der Ergebnisse in einer möglichst sinnvollen Form.

In der Regel erfolgt die Datenbeschaffung automatisch, im Internet durch Webcrawler, auf einem einzelnen Computer durch regelmäßiges Einlesen aller Dateien in vom Benutzer spezifizierten Verzeichnissen im lokalen Dateisystem.

Merkmale

Suchmaschinen sind Metamedien, die gezielt Inhalte anderer Medien auffinden und abgreifen. Sie lassen sich nach einer Reihe von Merkmalen kategorisieren. Die nachfolgenden Merkmale sind weitgehend unabhängig. Man kann sich beim Entwurf einer Suchmaschine also für eine Möglichkeit aus jeder der Merkmalsgruppen entscheiden, ohne dass diese die Wahl der anderen Merkmale beeinflusst.

Art der Daten

Verschiedene Suchmaschinen können unterschiedliche Arten von Daten durchsuchen. Zunächst lassen sich diese grob in „Dokumenttypen“ wie Text, Bild, Ton, Video und andere unterteilen. Ergebnisseiten werden in Abhängigkeit von dieser Gattung gestaltet. Bei einer Suche nach Textdokumenten wird üblicherweise ein Textfragment angezeigt, das die Suchbegriffe enthält (häufig Snippet genannt). Bildsuchmaschinen zeigen eine Miniaturansicht der passenden Bilder an. Eine Personensuchmaschine findet öffentlich verfügbare Informationen zu Namen und Personen, die als Linkliste dargestellt werden. Weitere spezialisierte Arten von Suchmaschinen sind zum Beispiel Jobsuchmaschinen, Branchensuchen oder Produktsuchmaschinen. Letztere werden vorrangig von Online-Preisvergleichen eingesetzt, es gibt aber auch schon lokale Angebotssuchen, die Produkte und Angebote stationärer Einzelhändler online darstellen.

Eine weitere feinere Aufgliederung geht auf datenspezifische Eigenschaften ein, die nicht alle Dokumente innerhalb einer Gattung teilen. Bleibt man beim Beispiel Text, so kann bei Usenet-Beiträgen nach bestimmten Autoren gesucht werden, bei Webseiten im HTML-Format nach dem Dokumententitel.

Je nach Datengattung ist als weitere Funktion eine Einschränkung auf eine Untermenge aller Daten einer Gattung möglich. Dieses wird im Allgemeinen über zusätzliche Suchparameter realisiert, die das Suchergebnis beispielsweise mit bestimmten Booleschen Ausdrücken (UND, ODER, NICHT), nach einer bestimmten Sprache, einem bestimmtes Land, einem bestimmten Zeitraum, einem bestimmten Dateiformat etc. aus den erfassten Daten herausfiltert. Alternativ kann sich eine Suchmaschine darauf beschränken, von Anfang an nur passende Dokumente aufzunehmen. Beispiele sind etwa eine Suchmaschine für Weblogs (statt für das komplette Web) oder Suchmaschinen, die nur Dokumente von Universitäten verarbeiten, oder ausschließlich Dokumente aus einem bestimmten Land, in einer bestimmten Sprache oder einem bestimmten Dateiformat.

Datenquelle

Ein anderes Merkmal zur Kategorisierung ist die Quelle, aus der die von der Suchmaschine erfassten Daten stammen. Meistens beschreibt bereits der Name der Suchmaschinenart die Quelle.

- Websuchmaschinen erfassen Dokumente aus dem World Wide Web,

- vertikale Suchmaschinen betrachten einen ausgewählten Bereich des World Wide Web und erfassen nur Webdokumente zu einem bestimmten Thema wie Fußball, Gesundheit oder Recht.

- Usenetsuchmaschinen Beiträge aus dem weltweit verteilten Diskussionsmedium Usenet.

- Intranetsuchmaschinen beschränken sich auf die Rechner des Intranets einer Firma.

- Enterprise Search Suchmaschinen ermöglichen eine zentrale Suche über verschiedene Datenquellen innerhalb eines Unternehmens, wie z. B. Fileserver, Wikis, Datenbanken und Intranet.

- Als Desktop-Suchmaschinen werden Programme bezeichnet, die den lokalen Datenbestand eines einzelnen Computers durchsuchbar machen.[1]

Wird die Datenbeschaffung manuell mittels Anmeldung oder durch Lektoren vorgenommen, spricht man von einem Katalog oder Verzeichnis. In solchen Verzeichnissen wie dem Open Directory Project sind die Dokumente hierarchisch in einem Inhaltsverzeichnis nach Themen organisiert.

Realisierung

Dieser Abschnitt beschreibt Unterschiede in der Realisierung des Betriebs der Suchmaschine.

- Die heutzutage wichtigste Gruppe sind indexbasierte Suchmaschinen. Diese lesen passende Dokumente ein und legen einen Index an. Dabei handelt es sich um eine Datenstruktur, die bei einer späteren Suchanfrage verwendet wird. Nachteil ist die aufwendige Pflege und Speicherung des Index, Vorteil ist die Beschleunigung des Suchvorgangs. Häufigste Ausprägung dieser Struktur ist ein Invertierter Index. Grundlegende Vorarbeiten für die Entwicklung leistete die Informatikerin Karen Spärck Jones, die statistische und linguistische Verfahren kombinierte.[2]

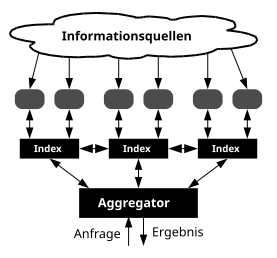

- Metasuchmaschinen senden Suchanfragen parallel an mehrere indexbasierte Suchmaschinen und kombinieren die Einzelergebnisse. Als Vorteil ergeben sich die größere Datenmenge sowie die einfachere Implementierung, da kein Index vorgehalten werden muss. Nachteil ist die relativ lange Dauer der Anfragebearbeitung. Außerdem ist das Ranking durch reine Mehrheitsfindung von fragwürdigem Wert. Die Qualität der Ergebnisse wird unter Umständen auf die Qualität der schlechtesten befragten Suchmaschine reduziert. Metasuchmaschinen sind vor allem bei selten vorkommenden Suchbegriffen sinnvoll.

- Weiterhin existieren Hybridformen. Diese besitzen einen eigenen, oft relativ kleinen Index, befragen aber auch andere Suchmaschinen und kombinieren schließlich die Einzelergebnisse. Sogenannte Echtzeitsuchmaschinen starten etwa den Indexierungsvorgang erst nach einer Anfrage. So sind die gefundenen Seiten zwar stets aktuell, die Qualität der Ergebnisse ist aber aufgrund der fehlenden breiten Datenbasis insbesondere bei weniger gängigen Suchbegriffen schlecht.

- Ein relativ neuer Ansatz sind Verteilte Suchmaschinen bzw. Föderierte Suchmaschinen. Dabei wird eine Suchanfrage an eine Vielzahl von einzelnen Computern weitergeleitet, die jeweils eine eigene Suchmaschine betreiben, und die Ergebnisse zusammengeführt. Vorteil ist die hohe Ausfallsicherheit aufgrund der Dezentralisierung und – je nach Sichtweise – die fehlende Möglichkeit, zentral zu zensieren. Schwierig zu lösen ist allerdings das Ranking, also die Sortierung der grundsätzlich passenden Dokumente nach ihrer Relevanz für die Anfrage.

- Eine besondere Art der Verteilten Suchmaschinen sind die auf dem Peer-to-Peer-Prinzip basierenden, die einen verteilten Index aufbauen. Auf jedem dieser Peers können unabhängige Crawler zensurresistent die Teile des Web erfassen, welche der jeweilige Peer-Betreiber durch einfache lokale Konfiguration definiert. Bekanntestes System ist, neben einigen vorwiegend akademischen Projekten (z. B. Minerva), die unter GNU-GPL freie Software YaCy.

Interpretation der Eingabe

Die Suchanfrage eines Nutzers wird vor der eigentlichen Suche interpretiert und in eine für den intern verwendeten Suchalgorithmus verständliche Form gebracht. Dies dient dazu, die Syntax der Anfrage möglichst einfach zu halten und dennoch komplexe Anfragen zu erlauben. Viele Suchmaschinen unterstützen die logische Verknüpfung von verschiedenen Suchworten durch Boolesche Operatoren und die exakte Suche nach ein oder mehreren Worten in Anführungszeichen.[3] Dadurch lassen sich Webseiten finden, die bestimmte Begriffe enthalten, andere jedoch nicht.

Eine neuere Entwicklung ist die Fähigkeit von etlichen Suchmaschinen, implizit vorhandene Informationen aus dem Zusammenhang der Suchanfrage selbst zu erschließen und zusätzlich auszuwerten. Die bei unvollständigen Suchanfragen typischerweise vorhandenen Mehrdeutigkeiten der Suchanfrage können so reduziert, und die Relevanz der Suchergebnisse (das heißt, die Übereinstimmung mit den bewussten oder unbewussten Erwartungen des/der Suchenden) erhöht werden. Aus den semantischen Gemeinsamkeiten der eingegebenen Suchbegriffe wird (siehe auch: Semantische Suche) auf eine, oder mehrere, hinterliegende Bedeutungen der Anfrage geschlossen. Die Ergebnismenge wird so um Treffer auf semantisch verwandte, in der Anfrage jedoch nicht explizit eingegebene Suchbegriffe, erweitert. Dies führt in der Regel nicht nur zu einer quantitativen, sondern, vor allem bei unvollständigen Anfragen und nicht optimal gewählten Suchbegriffen, auch zu einer qualitativen Verbesserung (der Relevanz) der Ergebnisse, weil die in diesen Fällen eher unscharf durch die Suchbegriffe abgebildeten Suchintentionen durch die von den Suchmaschinen verwendeten statistischen Verfahren in der Praxis erstaunlich gut wiedergegeben werden. (Siehe auch: semantische Suchmaschine und Latent Semantic Indexing).

Unsichtbar mitgegebene Informationen (Ortsangaben, und andere Informationen, im Fall von Anfragen aus dem Mobilfunknetz) oder erschlossene 'Bedeutungsvorlieben' aus der gespeicherten Suchhistorie des Benutzers sind weitere Beispiele für nicht explizit in den eingegebenen Suchbegriffen vorgegebene, von etlichen Suchmaschinen zur Modifikation und Verbesserung der Ergebnisse verwendete Informationen.

Es gibt daneben auch Suchmaschinen, die nur mit streng formalisierten Abfragesprachen abgefragt werden können, dadurch in der Regel jedoch auch sehr komplexe Anfragen sehr präzise beantworten können.

Eine bislang noch nur ansatzweise oder auf beschränkte Informationsgrundlagen realisierbare Fähigkeit von Suchmaschinen ist die Fähigkeit zur Bearbeitung natürlichsprachiger sowie unscharfer Suchanfragen. (Siehe auch: semantisches Web).

Probleme

Mehrdeutigkeit

Suchanfragen sind oft unpräzise. So kann die Suchmaschine nicht selbstständig entscheiden, ob beim Begriff Laster nach einem Lkw oder einer schlechten Angewohnheit gesucht werden soll (semantische Korrektheit). Umgekehrt sollte die Suchmaschine nicht zu stur auf dem eingegebenen Begriff bestehen. Sie sollte auch Synonyme einbeziehen, damit der Suchbegriff Rechner Linux auch Seiten findet, die statt Rechner das Wort Computer enthalten.

Grammatik

Viele mögliche Treffer gehen verloren, weil der Nutzer nach einer bestimmten grammatikalischen Form eines Suchbegriffes sucht. So findet die Suche nach dem Begriff Auto zwar alle im Suchindex enthaltenen Seiten, die diesen Begriff enthalten, nicht aber jene mit dem Begriff Autos. Manche Suchmaschinen erlauben die Suche mittels Wildcards, mit denen sich dieses Problem teilweise umgehen lässt (z. B. berücksichtigt die Suchanfrage Auto* auch den Begriff Autos oder Automatismus), allerdings muss der Nutzer die Möglichkeit auch kennen. Weiterhin wird oft Stemming verwendet, dabei werden Wörter auf ihren Grundstamm reduziert. So ist einerseits eine Abfrage nach ähnlichen Wortformen möglich (schöne Blumen findet so auch schöner Blume), außerdem wird die Anzahl der Begriffe im Index reduziert. Die Nachteile des Stemmings können durch eine linguistische Suche ausgeglichen werden, indem alle Wortvarianten erzeugt werden. Eine weitere Möglichkeit ist der Einsatz statistischer Verfahren, mit denen die Suchmaschine die Anfrage z. B. durch das Auftauchen verschiedener verwandter Begriffe auf Webseiten danach bewertet, ob mit der Suche nach Auto reparieren auch die Suche nach Autos reparatur oder Automatismus repariert gemeint gewesen sein könnte.

Satzzeichen

Fachbegriffe und Produktbezeichnungen, zu deren Eigennamen ein Satzzeichen gehört (z. B. Apples Webservice .Mac oder C/net), können bei den gängigen Suchmaschinen nicht effektiv gesucht und gefunden werden. Lediglich für ein paar sehr häufige Begriffe (z. B. .Net, C#, oder C++) wurden Ausnahmen geschaffen.[4]

Datenmenge

Die Datenmengen wachsen oft sehr schnell. Mit Datenmengen, welche beispielsweise zu groß, zu komplex, zu schnelllebig oder zu schwach strukturiert sind, um sie mit manuellen und herkömmlichen Methoden der Datenverarbeitung auszuwerten, beschäftigt sich Big Data.

Aktualität

Viele Dokumente werden häufig aktualisiert, was die Suchmaschinen zwingt, diese Seiten nach definierbaren Regeln immer wieder neu zu indexieren. Dieses ist auch notwendig, um zwischenzeitlich aus der Datenbasis entfernte Dokumente zu erkennen und nicht länger als Ergebnis anzubieten.

Technik

Suchen auf sehr großen Datenmengen so umzusetzen, dass die Verfügbarkeit hoch ist (trotz Hardware-Ausfällen und Netzengpässen) und die Antwortzeiten niedrig (obwohl oft pro Suchanfrage das Lesen und Verarbeiten mehrerer 100 MB Index-Daten erforderlich ist), stellt große Anforderungen an den Suchmaschinenbetreiber. Systeme müssen sehr redundant ausgelegt sein, zum einen auf den Computern vor Ort in einem Rechenzentrum, zum anderen sollte es mehr als ein Rechenzentrum geben, das die komplette Suchmaschinenfunktionalität anbietet.

Websuchmaschinen

Websuchmaschinen haben ihren Ursprung in Information-Retrieval-Systemen. Die Datenbeschaffung erfolgt durch den Webcrawler der jeweiligen Suchmaschine wie bspw. Googlebot. Etwa ein Drittel aller Suchanfragen im Internet bezieht sich auf Personen und deren Aktivitäten.[5]

Suchverhalten

Suchanfragen lassen sich auf verschiedene Art kategorisieren.[6][7] Im Online-Marketing und in der Suchmaschinenoptimierung (Suchmaschinenmarketing) spielt diese Einteilung eine Rolle[8][9].

- Navigationsorientierte Suchanfragen

- Der Nutzer sucht bei navigationalen Anfragen gezielt nach Seiten, die er bereits kennt, oder von denen er glaubt, sie existieren. Das Informationsbedürfnis des Nutzers ist nach dem Auffinden der Seite befriedigt.

- Informationsorientierte Suchanfragen

- Der Nutzer sucht bei informationalen Anfragen eine Vielzahl von Angaben zu einem bestimmten Themengebiet. Mit Erhalt der Information ist die Suche beendet. Ein weiteres Arbeiten mit den benutzten Seiten bleibt meist aus.

- Transaktionsorientierte Suchanfragen (bzw. kommerzielle Suchanfragen)

- Der Nutzer sucht bei transaktionalen Anfragen nach Internetseiten, mit denen er zu arbeiten gedenkt. Dies sind zum Beispiel Internetshops, Chats usw.

- Suchanfrage vor einem Kauf

- Der Nutzer sucht beispielsweise gezielt nach Testberichten oder Reviews zu bestimmten Produkten, ist aber noch nicht auf der Suche nach konkreten Angeboten zu einem Produkt.

- Aktionsorientierte Suchanfragen

- Der Nutzer signalisiert durch seine Suchanfrage, dass er etwas tun möchte (etwas herunterladen oder ein Video ansehen).

Darstellung der Ergebnisse

Die Seite, auf der die Suchergebnisse dem Benutzer ausgegeben werden (manchmal auch als Search engine results page, kurz: SERP, bezeichnet), gliedert sich (häufig auch räumlich) bei vielen Websuchmaschinen in die Natural Listings und die Sponsorenlinks. Während letztere ausschließlich gegen Bezahlung in den Suchindex aufgenommen werden, sind in ersteren alle dem Suchwort entsprechenden Webseiten aufgelistet. Einige Anbieter zeigen dem Nutzer, neben den eigentlichen Suchergebnissen, weitere zur Suche passende Schlagwörter an.

Um dem Anwender die Benutzung der Websuchmaschinen zu erleichtern, werden Ergebnisse nach Relevanz (Hauptartikel: Suchmaschinenranking) sortiert, wofür jede Suchmaschine ihre eigenen, meistens geheim gehaltenen Kriterien heranzieht. Dazu gehören:

- Die grundlegende Bedeutung eines Dokuments, gemessen durch die Linkstruktur, der Qualität der verweisenden Dokumente sowie in Verweisen enthaltener Text.

- Häufigkeit und Stellung der Suchbegriffe im jeweiligen gefundenen Dokument.

- Umfang und Qualität des Dokuments.

- Einstufung und Anzahl der zitierten Dokumente.

Siehe auch: Verordnung zur Förderung von Fairness und Transparenz von Online-Vermittlungsdiensten und Online-Suchmaschinen der Europäischen Union.

Probleme

Recht

Websuchmaschinen werden meistens international betrieben und bieten somit Benutzern Ergebnisse von Servern, die in anderen Ländern stehen. Da die Gesetzgebungen der verschiedenen Länder unterschiedliche Auffassungen davon haben, welche Inhalte erlaubt sind, geraten Betreiber von Suchmaschinen oft unter Druck, gewisse Seiten von ihren Ergebnissen auszuschließen. So zeigen die marktführenden Websuchmaschinen seit 2006 bei aus Deutschland stammenden Suchanfragen keine Webseiten mehr als Treffer an, die von der Bundesprüfstelle für jugendgefährdende Medien als jugendgefährdend eingestuft wurden. Diese Praxis erfolgt von Seiten der Suchmaschinen freiwillig als automatisiertes Verfahren (Filtermodul) im Rahmen des Vereins Freiwillige Selbstkontrolle Multimedia-Diensteanbieter.

Aktualität

Das regelmäßige Herunterladen der mehreren Milliarden Dokumente, die eine Suchmaschine im Index hat, stellt große Anforderungen an die Netzwerkressourcen (Traffic) des Suchmaschinenbetreibers.

Spam

Mittels Suchmaschinen-Spamming versuchen manche Website-Betreiber, den Ranking-Algorithmus der Suchmaschinen zu überlisten, um eine bessere Platzierung für gewisse Suchanfragen zu bekommen. Sowohl den Betreibern der Suchmaschine als auch deren Kunden schadet dieses, da nun nicht mehr die relevantesten Dokumente zuerst angezeigt werden.

Datenschutz

Vor allem bei einer Personensuchmaschine ist der Datenschutz ein heikles Thema. Wenn über eine Personensuchmaschine eine Suche nach einem Namen gestartet wird, betreffen die Ergebnisse der Suche nur Daten, die allgemein zugänglich sind. Diese Daten sind auch ohne die Suchmaschine für die Allgemeinheit ohne Vornahme einer Registrierung bei einem Dienst oder Ähnlichem zugänglich. Die Personensuchmaschine selbst hält keine eigenen Informationen vor, sondern vermittelt nur den Zugang zu diesen. Korrekturen oder Löschungen müssen an der jeweiligen Ursprungsquelle vorgenommen werden.[10] Weitere rechtliche Fragen ergeben sich bzgl. der Anzeige von Daten durch die Autovervollständigung (siehe Rechtslage in Deutschland). Besonders die Suchmaschine DuckDuckGo wird im Zusammenhang mit restriktivem Tracking oft erwähnt. Im Gegensatz zu Google und anderen großen Suchmaschinen werden keine personenbezogenen Daten gespeichert, die für Werbemaßnahmen genutzt werden können. Im August 2022 wurde zudem bekannt, dass seither jegliche Tracking-Scripte von Microsoft blockiert werden. Damit reagieren die Macher von DuckDuckGo auf Kritik, die im Rahmen einer Untersuchung des Sicherheitsforscher Zach Edwards zutage kam (demnach konnte Microsoft sämtliche Nutzeraktivitäten webseitenübergreifend tracken).[11]

Umweltschutz

Jede Suchanfrage verbraucht Energie. Demnach verursachen beispielsweise 50 Google-Suchanfragen laut einer Rechnung des Öko-Instituts jährliche Treibhausgasemissionen von 26 Kilogramm.[12] Da jede Suchanfrage (Server-)Strom verbraucht, gibt es Anbieter (sogenannte „grüne Suchmaschinen“), die auf CO2-ausgleichende oder -sparende Maßnahmen setzen (z. B. Bäume pflanzen, den Regenwald wiederaufforsten). Bekannte Vertreter sind z. B. Ecosia, Gexsi, Ekoru und Lilo.

Marktanteile

Deutschland

| Name | Anteil der Suchanfragen in Deutschland im Februar 2021[13] | Prozent | ||

|---|---|---|---|---|

|

|

90,47 % | |||

| Bing |

|

6,14 % | ||

| Ecosia (verwendet Bing) |

|

1,07 % | ||

| DuckDuckGo |

|

0,88 % | ||

| Yahoo! (verwendet Bing)[14] |

|

0,7 % | ||

| T-Online (verwendet Google) |

|

0,23 % | ||

| Sonstige (z. B. Egerin) |

|

0,51 % |

Weltweit

| Name | Anteil der Suchanfragen weltweit im Juli 2022 [15] | Prozent | ||

|---|---|---|---|---|

|

|

65,82 % | |||

| Bing |

|

20,72 % | ||

| Yahoo! (verwendet Bing)[14] |

|

3,47 % | ||

| Baidu |

|

3,40 % | ||

| Yandex |

|

5,69 % | ||

| DuckDuckGo |

|

0,49 % | ||

| Naver |

|

0,20 % | ||

| Ecosia (verwendet Bing) |

|

0,10 % | ||

| Qwant |

|

0,02 % | ||

| Daum |

|

0,03 % |

Siehe auch

Literatur

- David Gugerli: Suchmaschinen. Die Welt als Datenbank (= Edition Unseld. Bd. 19). Suhrkamp, Frankfurt am Main 2009, ISBN 978-3-518-26019-7.

- Nadine Höchstötter, Dirk Lewandowski: What the users see – Structures in search engine results pages. In: Information Sciences Bd. 179, Nr. 12, 2009, ISSN 0020-0255, S. 1796–1812, doi:10.1016/j.ins.2009.01.028.

- Konrad Becker, Felix Stalder (Hrsg.): Deep search: Politik des Suchens jenseits von Google. Innsbruck Wien Bozen: StudienVerlag 2009. ISBN 978-3-7065-4794-9.

- Dirk Lewandowski: Suchmaschinen. In: Rainer Kuhlen, Wolfgang Semar, Dietmar Strauch (Hrsg.): Grundlagen der praktischen Information und Dokumentation. 6. Ausgabe. Walter de Gruyter, Berlin 2013, ISBN 978-3-11-025826-4.

- Dirk Lewandowski: Suchmaschinen verstehen. 2. Auflage. Springer, Heidelberg 2018, ISBN 978-3-662-56410-3.

- Dirk Lewandowski (Hrsg.): Handbuch Internet-Suchmaschinen. 3 Bände. AKA, Akademische Verlags-Gesellschaft, Heidelberg 2009–2013;

- Band 1: Dirk Lewandowski: Nutzerorientierung in Wissenschaft und Praxis. 2009, ISBN 978-3-89838-607-4;

- Band 2: Dirk Lewandowski: Neue Entwicklungen in der Web-Suche. 2011, ISBN 978-3-89838-651-7.

- Band 3: Dirk Lewandowski: Suchmaschinen zwischen Technik und Gesellschaft. 2013, ISBN 978-3-89838-680-7.

- Sven Konstantin: Poster „Auf den Spuren der Suche – die Geschichte der Suchmaschinen“. In: Search Studies. 23. April 2018.

- Suchmaschinen im Test: Eine schlägt Google. In: www.test.de. test (Zeitschrift), 26. März 2019.

Weblinks

- Linkkatalog zum Thema Liste von Suchmaschinen bei curlie.org (ehemals DMOZ)

- Dossier: Die Politik des Suchens bei der bpb

Einzelnachweise

- ↑ Artur Hoffmann: Suchmaschinen für PCs. In: PC Professionell 2/2007, S. 108ff.

- ↑ https://www.nytimes.com/2019/01/02/obituaries/karen-sparck-jones-overlooked.html

- ↑ Websuchen optimieren. Archiviert vom Original am 27. November 2020. Abgerufen am 7. Januar 2021.

- ↑ Google-Suchhilfen

- ↑ Personen-Suchmaschinen: Die Spuren der Anderen im Internet. In: Stern digital

- ↑ Lewandowski, Dirk,: Web-2.0-Dienste als Ergänzung zu algorithmischen Suchmaschinen. Logos-Verl, Berlin 2008, ISBN 978-3-8325-1907-0, S. 57.

- ↑ Andrei Broder: A taxonomy of web search. In: ACM SIGIR Forum. Bd. 36, Nr. 2, 2002, ISSN 0163-5840, S. 3–10, doi:10.1145/792550.792552.

- ↑ Arten von Suchanfragen (transaktionale/navigationale/informationale) | Content Marketing Glossar. In: textbroker.de. Abgerufen am 1. Juli 2019 (deutsch).

- ↑ Vanessa Fox: Marketing in the Age of Google. John Wiley & Sons, 2012, S. 67–68.

- ↑ Yasni: Personensuchmaschine am Start basicthinking.de, 29. Oktober 2007

- ↑ Aufregung um Duck Duck Go: Der Anti-Tracking-Browser lässt Tracking durch Microsoft zu. Abgerufen am 8. August 2022 (österreichisches Deutsch).

- ↑ Bettina Ullrich: Google-Alternativen: Diese Suchmaschinen bieten Datenschutz – und Klimaschutz | Sonntagsblatt - 360 Grad evangelisch. Abgerufen am 8. August 2022.

- ↑ Search Engine Market Share Germany. Abgerufen am 2. März 2021 (englisch).

- ↑ a b Golem.de: IT-News für Profis. Abgerufen am 21. März 2021.

- ↑ Search engine market share. Abgerufen am 2. März 2021 (englisch).